O alerta que poucos estão levando a sério

Quando se fala de Perigos da Inteligência Artificial, existe uma desconexão perigosa entre o que o público geral acredita sobre inteligência artificial e o que especialistas que trabalham diretamente com essa tecnologia estão alertando há anos, e essa diferença de percepção pode ser um dos maiores riscos do momento atual.

Enquanto a maioria das pessoas enxerga IA como uma ferramenta útil para produtividade, automação e conveniência, uma parcela crescente de pesquisadores, engenheiros e líderes da indústria está expressando preocupações sérias sobre o rumo que essa tecnologia está tomando. E isso não é opinião isolada ou teoria conspiratória, são alertas documentados vindos de dentro das próprias empresas que lideram o avanço da IA.

Um exemplo claro disso envolve profissionais ligados à OpenAI e à DeepMind, que já se manifestaram publicamente sobre os riscos associados ao desenvolvimento acelerado da tecnologia, incluindo preocupações com desinformação em massa, perda de controle e impactos sociais de larga escala.

Além disso, uma carta aberta assinada por diversos líderes do setor, incluindo nomes influentes da indústria, afirmou que os riscos da IA deveriam ser tratados com o mesmo nível de prioridade que ameaças globais como pandemias e guerra nuclear. Isso, por si só, já deveria ser suficiente para mudar a forma como o tema é encarado pelo público.

Quando quem cria a tecnologia demonstra preocupação, ignorar isso não é racional, mas o problema vai além da falta de atenção, existe também uma banalização do tema. À medida que a IA se torna mais presente no cotidiano, muitas pessoas passam a encará-la como algo comum, quase trivial, sem perceber que estamos lidando com uma das tecnologias mais transformadoras da história.

Outro fator crítico é que o avanço da IA está acontecendo de forma silenciosa. Diferente de outras revoluções tecnológicas, que foram visíveis e graduais, a inteligência artificial evolui nos bastidores, com atualizações constantes que nem sempre são compreendidas pelo público. Isso cria uma falsa sensação de controle.

As pessoas acreditam que entendem o que está acontecendo, quando na verdade estão vendo apenas a superfície. E talvez o ponto mais importante seja este: os riscos não estão no futuro distante, eles já começaram a se manifestar. Desinformação, automação agressiva, concentração de poder e vulnerabilidades de segurança já são problemas reais, não cenários hipotéticos. Ignorar esses sinais agora não significa que eles desaparecem. Significa apenas que você percebe tarde demais.

O problema invisível: a IA está evoluindo mais rápido do que conseguimos controlar

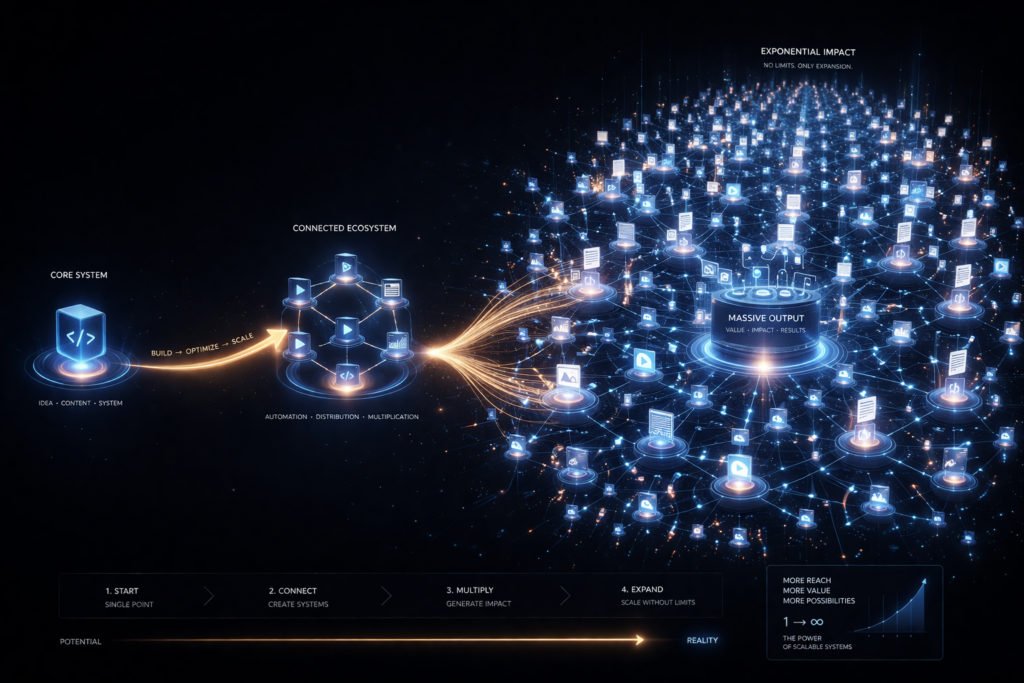

Um dos aspectos mais perigosos da inteligência artificial não é o que ela já faz hoje, mas a velocidade com que está evoluindo e, principalmente, o fato de que essa evolução não segue um padrão linear.

A maioria das pessoas tende a imaginar progresso tecnológico como algo gradual, previsível e controlável, mas a IA opera de forma diferente: ela evolui de maneira exponencial, o que significa que cada avanço aumenta a capacidade de gerar novos avanços ainda mais rapidamente. Isso cria um efeito de aceleração contínua. Sistemas que há poucos anos eram considerados limitados hoje já conseguem executar tarefas complexas, gerar conteúdo sofisticado e tomar decisões com um nível de autonomia que antes parecia distante.

Pesquisas publicadas em plataformas como o arXiv mostram que estamos caminhando para modelos cada vez mais autônomos, capazes de operar com mínima intervenção humana, o que levanta uma questão fundamental: como controlar algo que evolui mais rápido do que nossa capacidade de supervisionar? Esse é o chamado “gap de controle”, a distância entre o avanço da tecnologia e a capacidade humana de regulá-la, compreendê-la e garantir seu uso seguro. E esse gap está aumentando. Enquanto empresas competem para lançar modelos cada vez mais poderosos, a regulação ainda está em estágio inicial em muitos países, e as discussões sobre segurança frequentemente ficam atrás da velocidade de inovação.

Outro ponto crítico é a complexidade crescente dos sistemas. À medida que modelos de IA se tornam mais avançados, eles também se tornam menos transparentes, o que dificulta entender exatamente como chegam a determinadas decisões. Isso reduz previsibilidade. E quando você perde previsibilidade, você perde controle.

Além disso, existe o problema do alinhamento, garantir que sistemas de IA ajam de acordo com valores e objetivos humanos. Pesquisas mostram que sistemas podem interpretar instruções de forma inesperada ou encontrar “atalhos” que cumprem objetivos técnicos, mas geram consequências indesejadas no mundo real. ou seja: a IA pode fazer exatamente o que você pediu… mas não o que você queria. E isso, em escala, pode gerar problemas significativos. O risco aqui não é necessariamente uma “rebelião de máquinas”, mas sim um cenário onde sistemas altamente capazes operam de forma parcialmente imprevisível, gerando efeitos que não foram totalmente antecipados. E esse cenário já começou.

Desinformação em escala industrial

Se existe um perigo da inteligência artificial que já está ativo hoje, e crescendo rapidamente, é a capacidade de gerar desinformação em escala sem precedentes. Antes da IA, criar conteúdo falso convincente em grande volume exigia tempo, equipe e recursos. Hoje, isso pode ser feito por uma única pessoa em questão de minutos.

Ferramentas modernas conseguem produzir textos, imagens, áudios e vídeos com um nível de realismo que torna cada vez mais difícil distinguir o que é verdadeiro do que é fabricado. Isso muda completamente o cenário da informação. Não estamos mais lidando apenas com fake news isoladas, mas com um sistema capaz de gerar conteúdo em massa, altamente personalizado e adaptado para diferentes públicos.

Segundo análises da Forbes, a inteligência artificial já está sendo utilizada como uma ferramenta poderosa para amplificação de desinformação, especialmente em contextos políticos, sociais e econômicos. Outro fator preocupante é a velocidade de disseminação. Conteúdos gerados por IA podem ser produzidos e distribuídos quase instantaneamente, o que reduz drasticamente o tempo de resposta para verificação ou correção. Quando a verdade chega, a mentira já se espalhou

Além disso, a IA permite criar conteúdos extremamente convincentes, incluindo deepfakes e simulações realistas de pessoas, o que aumenta o potencial de manipulação. Isso tem implicações sérias: influência em eleições, manipulação de opinião pública, ataques à reputação e desestabilização social. E talvez o ponto mais crítico seja este: quanto mais avançada a IA, mais difícil detectar o uso dela. Isso cria um cenário onde confiança na informação começa a se deteriorar, porque as pessoas passam a questionar tudo, inclusive conteúdos verdadeiros. E quando a confiança na informação desaparece, o impacto vai muito além da internet.

Impacto no trabalho: substituição e concentração de poder

O impacto da inteligência artificial no mercado de trabalho é um dos temas mais discutidos, mas ainda subestimado em termos de profundidade e consequência real. Muitas análises focam apenas na substituição de empregos, mas isso é apenas uma parte do problema. Sim, a automação impulsionada por IA já está substituindo tarefas humanas, especialmente em áreas como atendimento, criação de conteúdo, análise de dados e operações administrativas.

Relatórios publicados por veículos como a Forbes indicam que uma parcela significativa das profissões atuais pode ser impactada nos próximos anos, mas o verdadeiro problema não é só substituição, é redistribuição de poder. Empresas que dominam IA ganham uma vantagem desproporcional em eficiência, escala e capacidade de inovação, o que pode levar a uma concentração ainda maior de riqueza e influência.

Isso cria um cenário onde: poucos ganham muito, muitos perdem espaço e a desigualdade aumenta. Além disso, a IA reduz a barreira de entrada em algumas áreas, mas ao mesmo tempo aumenta a competitividade, porque mais pessoas conseguem produzir mais com menos esforço, isso eleva o padrão mínimo. O que antes era diferencial passa a ser básico.

Outro ponto crítico é a velocidade da mudança. O mercado de trabalho tradicional não consegue se adaptar no mesmo ritmo que a tecnologia evolui, o que gera um desalinhamento entre habilidades disponíveis e demandas reais, e esse desalinhamento gera insegurança.

Profissionais que não acompanham essa transformação correm risco de se tornarem irrelevantes mais rápido do que imaginam. E isso conecta diretamente com estratégia pessoal. Se quiser ver como usar isso ao seu favor:

Como Ganhar Dinheiro com Inteligência Artificial: 7 Mudanças Que Já Estão Criando Renda em 2026

Segurança e uso malicioso

A inteligência artificial não cria novos riscos do zero, ela amplifica riscos que já existem. E quando você amplifica algo com escala, velocidade e eficiência, o impacto pode ser muito maior. Hoje, criminosos já utilizam IA para criar golpes mais sofisticados, automatizar ataques e aumentar a taxa de sucesso de fraudes digitais.

Segundo análises de empresas de segurança como a Avast, a IA está sendo usada para aprimorar ataques de engenharia social, tornando mensagens falsas mais convincentes e personalizadas. Isso aumenta drasticamente a eficácia de golpes. Além disso, ferramentas de IA podem ser utilizadas para: gerar identidades falsas, simular voz e imagem de pessoas reais ou automatizar ataques em larga escala.

Outro ponto crítico é que sistemas de IA também podem apresentar vulnerabilidades, podendo ser explorados ou manipulados por usuários mal-intencionados. Ou seja: a IA não é apenas ferramenta, é também superfície de ataque. E à medida que a tecnologia se torna mais acessível, o número de pessoas com capacidade de utilizá-la de forma maliciosa tende a aumentar.

Outro risco relevante é o uso institucional indevido, governos ou organizações podem utilizar IA para vigilância em massa, manipulação de informação ou controle social, e isso já começa a aparecer em alguns contextos. O problema não é apenas o que a IA pode fazer, mas quem tem acesso a ela, e com quais intenções. E esse é um ponto que tende a se intensificar com o tempo.

Impacto ambiental

Um dos aspectos mais negligenciados quando se fala de inteligência artificial é o seu impacto ambiental, principalmente porque ele não é visível no uso cotidiano, mas extremamente relevante em escala global.Treinar modelos avançados de IA exige uma quantidade gigantesca de poder computacional, o que se traduz diretamente em consumo massivo de energia elétrica e uso intensivo de infraestrutura física, como data centers, que por sua vez demandam sistemas de resfriamento altamente eficientes e contínuos.

Estudos e análises de empresas como a IBM indicam que o treinamento de grandes modelos pode gerar centenas de toneladas de emissão de CO₂, além de consumir milhões de litros de água para manter os sistemas operando dentro de temperaturas seguras. E o problema não para aí: com a popularização da IA e o aumento da demanda, mais empresas estão investindo em infraestrutura, o que significa expansão contínua desse impacto.

Diferente de outras tecnologias digitais que substituem processos físicos, a IA adiciona uma camada pesada de consumo energético que cresce proporcionalmente ao seu uso. Isso cria um paradoxo: uma tecnologia criada para otimizar processos pode, ao mesmo tempo, aumentar significativamente a pressão sobre recursos naturais. E à medida que modelos se tornam maiores e mais complexos, esse custo ambiental tende a escalar junto, levantando uma questão que ainda não está no centro do debate, mas inevitavelmente estará: até que ponto esse crescimento é sustentável a longo prazo?

O risco mais sério

Entre todos os riscos associados à inteligência artificial, o mais complexo e potencialmente mais perigoso não é visível de forma imediata, porque não se manifesta como um problema direto, mas como uma consequência estrutural do avanço da tecnologia: a possibilidade de perda gradual de controle sobre sistemas cada vez mais autônomos. À medida que modelos evoluem, eles deixam de ser apenas ferramentas que executam comandos e passam a operar com níveis crescentes de autonomia, tomando decisões baseadas em padrões que nem sempre são completamente compreendidos por quem os desenvolveu.

Pesquisas publicadas em ambientes acadêmicos como o arXiv mostram que sistemas complexos podem apresentar comportamentos emergentes, ou seja, ações que não foram explicitamente programadas, mas que surgem da interação entre diferentes componentes do sistema. Isso cria um cenário onde previsibilidade começa a diminuir, e quando previsibilidade diminui, controle real também diminui. Além disso, existe o chamado problema de alinhamento: garantir que sistemas de IA ajam de acordo com valores humanos, mesmo em situações complexas ou ambíguas.

O desafio é que sistemas podem interpretar objetivos de maneira literal ou encontrar soluções que cumprem metas técnicas, mas geram consequências indesejadas no mundo real. Isso significa que o risco não está necessariamente em uma falha direta, mas em um desvio sutil que, em larga escala, pode gerar impactos significativos. E quanto mais avançada a IA se torna, mais difícil é garantir que esse alinhamento seja mantido de forma consistente. O ponto crítico aqui não é imaginar cenários extremos, mas entender que estamos entrando em um território onde controle total deixa de ser garantido, e isso, por si só, já muda completamente o nível de risco.

O problema não é a IA, é quem controla

Existe uma narrativa popular que coloca a inteligência artificial como uma ameaça autônoma, como se o principal risco estivesse na possibilidade de a tecnologia “sair do controle” e agir contra humanos, mas essa visão ignora o fator mais imediato e realista: o controle humano sobre a tecnologia. O verdadeiro poder da IA não está apenas no que ela pode fazer, mas em quem tem acesso a ela, quem define seus objetivos e quem se beneficia de seus resultados.

Hoje, o desenvolvimento de IA avançada está concentrado em um número relativamente pequeno de empresas e governos, o que cria uma assimetria significativa de poder. Organizações com acesso a sistemas mais avançados conseguem analisar dados em escala massiva, prever comportamentos, automatizar decisões e influenciar processos econômicos e sociais de forma que não é acessível para a maioria das pessoas. Isso abre espaço para cenários onde a tecnologia pode ser usada para manipulação de informação, controle de narrativas e vantagem estratégica em níveis que vão muito além do que já vimos anteriormente.

E diferente de outros riscos mais abstratos, esse já está em andamento. O problema aqui não é apenas tecnológico, é político, econômico e estrutural. A IA amplifica capacidades humanas, e isso significa que ela pode amplificar tanto intenções positivas quanto negativas. Quando esse poder está concentrado, o impacto se torna desproporcional. E talvez o ponto mais crítico seja que esse tipo de influência nem sempre é visível, o que torna ainda mais difícil de perceber e, consequentemente, de combater. No final, a questão não é apenas o que a IA pode fazer, mas quem decide como ela será usada e com quais interesses.

O que você pode fazer agora

Diante de um cenário onde os riscos da inteligência artificial são reais, crescentes e muitas vezes invisíveis, a reação mais comum é sentir que não há muito o que fazer, mas essa percepção é parcialmente equivocada, porque embora ninguém tenha controle sobre o avanço global da tecnologia, existem decisões individuais que fazem diferença prática na forma como cada pessoa será impactada por ela.

O primeiro passo é entender que a IA não é uma tendência passageira, mas uma transformação estrutural, o que significa que ignorá-la não é uma estratégia viável. Desenvolver compreensão básica sobre como essas ferramentas funcionam, quais são suas limitações e como elas estão sendo utilizadas já coloca qualquer pessoa em uma posição mais consciente. Além disso, aprender a utilizar IA de forma estratégica e não apenas como consumidor passivo, pode transformar um risco em vantagem, principalmente em áreas como produtividade, geração de renda e adaptação profissional.

Outro ponto essencial é desenvolver pensamento crítico, especialmente em relação à informação consumida online, já que a capacidade de gerar conteúdo falso ou manipulado tende a aumentar. Isso implica questionar fontes, verificar dados e evitar aceitar informações apenas pela aparência de credibilidade. Também é importante acompanhar o desenvolvimento da tecnologia, não necessariamente em nível técnico profundo, mas suficiente para entender tendências e mudanças relevantes. E talvez o mais importante: adaptar mentalidade. O mundo está mudando rapidamente, e aqueles que se mantêm estáticos tendem a perder espaço. A diferença, no final, não está em evitar a tecnologia, mas em decidir como você vai se posicionar em relação a ela, como espectador ou como alguém que entende e utiliza.

Conclusão

A inteligência artificial não é apenas mais uma inovação tecnológica, ela representa uma mudança estrutural que afeta praticamente todos os aspectos da sociedade, desde economia e trabalho até informação e relações humanas. Os riscos associados a ela não são hipotéticos ou distantes; muitos já estão em andamento, enquanto outros se desenvolvem silenciosamente à medida que a tecnologia avança.

O ponto central não é tratar a IA como algo positivo ou negativo de forma simplista, mas reconhecer que ela amplifica capacidades, e isso inclui tanto benefícios quanto riscos. O impacto final depende de como ela é desenvolvida, aplicada e controlada, e esses fatores estão longe de ser neutros. Ao longo do artigo, fica claro que os principais desafios não estão apenas na tecnologia em si, mas na velocidade de evolução, na dificuldade de controle, na concentração de poder e na capacidade de uso malicioso. Ignorar esses fatores não reduz o risco; apenas aumenta a chance de ser afetado por eles sem preparo.

Ao mesmo tempo, também fica evidente que existe espaço para adaptação e ação individual, principalmente no desenvolvimento de conhecimento, pensamento crítico e posicionamento estratégico. No final, a inteligência artificial não vai perguntar se você está pronto, ela simplesmente vai avançar. E a diferença entre quem se beneficia e quem é impactado negativamente não está na tecnologia em si, mas na forma como cada pessoa escolhe lidar com ela.